概述

Portkey 是为 GenAI 构建者设计的生产级 LLMOps 平台,目标是把模型访问、治理、监控和提示工程集中到一个可管理的工作流中。它把传统上分散在多个服务的能力——模型路由、缓存、审计、Prompt 管理与安全策略——整合进一个统一的 AI Gateway,便于团队快速上线、降低成本并提升可观测性与合规性。

核心能力

-

统一 AI Gateway: 通过单一 API 访问 1600+ 模型与多个模型提供商,免去频繁改动底层集成代码的麻烦,支持路由、版本管理与故障降级。

-

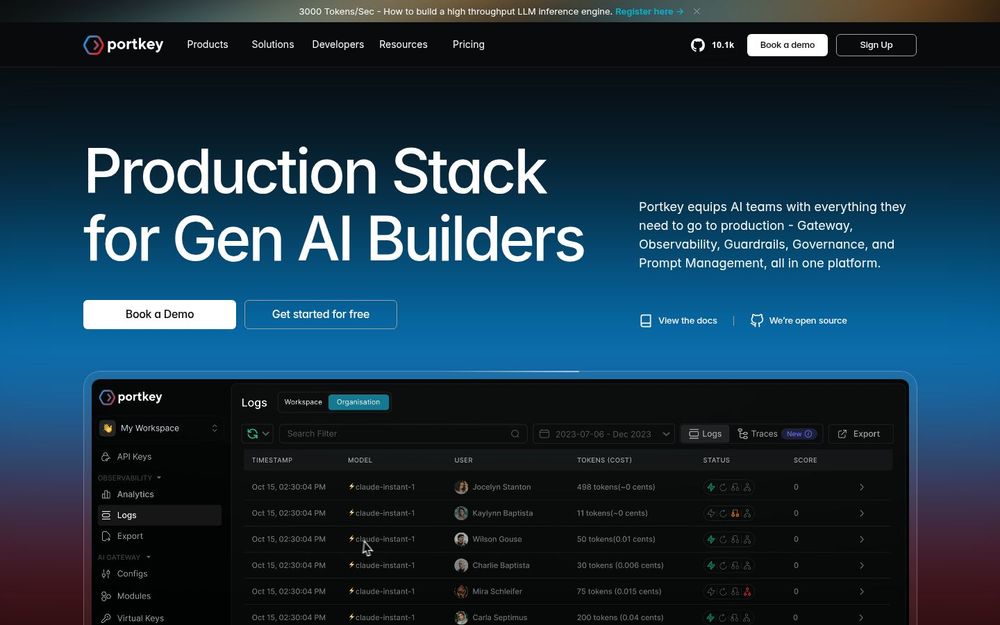

可观测性与审计: 提供实时仪表盘、调用链追踪与详细活动日志,便于发现异常、回溯问题并量化延迟与成本指标。

-

Guardrails 与敏感信息脱敏: 内置 PII Redaction 与网络/请求级别的防护机制,确保在发送到上游模型前自动脱敏和施行策略,降低合规风险。

-

Prompt 管理与模型目录: 集中管理提示(prompts)与模型配置,支持实验、版本控制与重现性,提升团队协作效率。

-

成本优化与缓存: 通过请求缓存、批处理和智能路由降低模型调用成本,并提供实时成本监控与预算限制功能。

部署与集成

Portkey 强调“即插即用”的体验,可以在几行代码内接入(提供 Node.js、Python、OpenAI JS/Py、cURL 等示例),并支持 MCP Gateway 的部署以集中认证和访问控制。对企业用户提供 RBAC、单点登录 (SSO)、组织层级管理与 SLA 支撑,适合从初创团队到大型企业的不同规模场景。

典型场景

- 将多模型、多供应商的调用统一管理,避免为每个模型编写适配器。

- 在对延迟和成本敏感的应用中启用缓存与批处理策略,显著降低调用费用。

- 面向合规场景(如 HIPAA、GDPR)自动脱敏和记录审计日志,便于合规性证明与安全审查。

推荐理由

Portkey 适合需要在生产环境中大规模管理 LLM 的团队:它不仅提供丰富的运维和治理能力(可观测性、审计、RBAC、PII 脱敏),还通过统一 API 与 Prompt 管理降低开发复杂度,加快从实验到生产的落地速度。若你关注成本可控性、合规与可观测性,并且希望在多模型生态中保持开发效率,Portkey 是一个值得考虑的解决方案。